Departamentul de Asistență Socială, Jurnalism, Relații Publice și Sociologie din cadrul ULBS a organizat astăzi, 13 mai, un eveniment la care au fost invitați să participe în jur de 50 de profesori din învățământul preuniversitar. Tema evenimentului a fost Inteligența Artificială în educație și impactul pe care aceasta îl are atât asupra calității activităților didactice, cât și asupra minților tinere ale elevilor.

Prima parte a evenimentului a constat întro prezentare despre AI realizată de Eduard-Claudiu Gross, Asistent Universitar la ULBS, Doctor în Științele Comunicării și cercetător în cadrul universității sibiene, unde munca sa se axează predominant pe impactul AI asupra societății, cum ar fi asupra educației, manipulării și proceselor electorale.

După o scurtă pauză de recreere și socializare a urmat și o secțiune de discuție liberă în care s-au discutat problemele ridicate privind inteligența artificială în educație cu accent pe experiențele profesionale personale și eventualele soluții care ar putea fi implementate pentru a mitiga efectele negative ale acestei noi tehnologii.

Discuția a fost moderată de Prof. Univ. Dr. Minodora Sălcudean, iar la eveniment au fost prezente mai multe cadre didactice din cadrul ULBS, printre care și Directoarea Departamentului de Asistență Socială, Jurnalism, Relații Publice și Sociologie, Adela Popa.

Halucinațiile – una din marile probleme ale inteligenței artificiale

Pentru a înțelege riscurile atașate acestei tehnologii, este important să înțelegem, cel puțin în termeni generali, felul în care aceasta funcționează. Gross ne explică faptul că AI nu este altceva decât o tehnologie uluitoare de text predictiv. AI nu cunoaște date sau informații, ci generează o inlănțuire de cuvinte care au probabilitatea cea mai mare să fie corecte pe baza promptului folosit și a datelor pe care a fost antrenat.

Problema mare apare însă în momentul în care acesta trebuie să răspundă la o întrebare pentru care nu a avut datele de antrenare necesare. Astfel, în loc să recunoască faptul că nu are la dispoziție datele necesare pentru a oferi un răspuns, AI va inventa unul. Acest fenomen este denumit ca fiind o „halucinație”, iar ea poate apărea în diferite forme – de la informații vizibil eronate, la surse false sau chiar falsități ambalate foarte credibil.

Această problemă tinde să fie și mai accentuată în ceea ce privește subiectele pentru care informațiile din mediul online sunt precare. Astfel, aceste LLM-uri (Large Language Model) sunt mai puțin precise și generează mai multe halucinații în versiunile în limba română față de cele în engleză.

„Costul real: suspiciunea contaminează tot” – cum detectoarele de AI nu sunt neapărat o soluție atât de bună

Detectoarele de AI sunt adesea folosite în încercarea de a identifica posibilele cazuri de plagiatură folosind AI. Problema cea mai mare, însă, din ceea ce ne spune Gross, e că această tehnologie nu doar că nu este precisă, ci provoacă și o relație de tensiune și neîncredere între porfesori și elevi.

Aceste detectoare adesea produc rezultate de fals-pozitiv, iar în cazurile reale de plagiat, ele sunt destul de ușor de ocolit, spre exemplu prin simpla inserare a unor greșeli de ortografie. Mai mult, rata de fals-pozitiv crește în rândul persoanelor bilingve, deoarece un vorbitor care nu este nativ va folosi adesea formulări și exprimări standardizate, pe care aceste tehnologii le pot identifica eronat ca fiind datorate inteligenței artificiale.

Astfel apare problema încrederii. Spre exemplu, dacă un astfel de soft semnalează lucrarea unui elev ca fiind realizată în mare parte de AI, iar profesorul îl confruntă, acesta nu are cum să demonstreze contrariul – practic, acesta nu poate „dovedi” un negativ. Din această cauză se instalează suspiciunea, toată clasa simțind că este suspectată sau sub investigație.

Această imposibilitate de a determina adevărul poate fi folosită și de figuri politice, care pot atribui filmări cu ei ca fiind generate cu AI, chiar și dacă nu este cazul.

În mai multe rânduri, aceste detectoare au identificat documente sau texte aflate în mediul online ca fiind generate cu AI, chiar și dacă ele au fost scrise cu mult înainte de apariția acestei tehnologii:

„Acest text este Declarația de Independență [a Statelor Unite] care apare că este generat cu inteligență artificială în proporție de 99%; sunt pasaje din Biblie care sunt catalogate ca fiind ca inteligență artificială. Aici motivul este simplu: aceste LLM-uri funcționează ca un malaxor, care introduc înăuntru toate informațiile disponibile pe internet și, în procesul de antrenare, cel mai probabil și le și atribuie.”

Cum pot fi folosite aceste LLM-uri corect

Cu toate că aceste tehnologii prezintă riscuri majore, acestea pot fi utile dacă sunt utilizate corect și pentru sarcinile la care sunt cele mai adaptate. Astfel, Gross ne oferă o listă cu diferitele LLM-uri și la ce sunt ele bune.

În cazul ChatGPT, primul astfel de model apărut pe piața comercială, riscul halucinațiilor îl face nepotrivit pentru obținerea unor informații de încredere. În schimb este bun pentru „brainstorming” – generarea rapidă a mai multor idei și selectarea celei potrivite pentru sarcina respectivă. În plus, acest model are și o versiune destul de dezvoltată în limba română.

Claude, modelul celor de la Anthropic, nu este atât de bun pe partea de limba română, însă este util când vine vorba de analizarea documentelor lungi. Și Notebook LM este util în această direcție, putând fi încărcate peste 50 de documente, astfel fiind util în ceea ce privește sarcini precum organizarea unui plan de lecție etc. și oferă sursele pentru fiecare informație generată.

Pentru a apela la cele mai recente surse, este indicată folosirea modelului Perplexity, iar în ceea ce privește bibliografia și sursele academice, Sălcudean ne recomandă modele precum Consensus AI sau Dimensions AI.

Riscurile folosirii excesive a inteligenței artificiale

Cu toate că pot exista întrebuințări pozitive ale inteligenței artificiale, aceasta vin la pachet cu un set de riscuri majore – multe din ele fiind obdervate și de către profesori pe parcursul activității didactice.

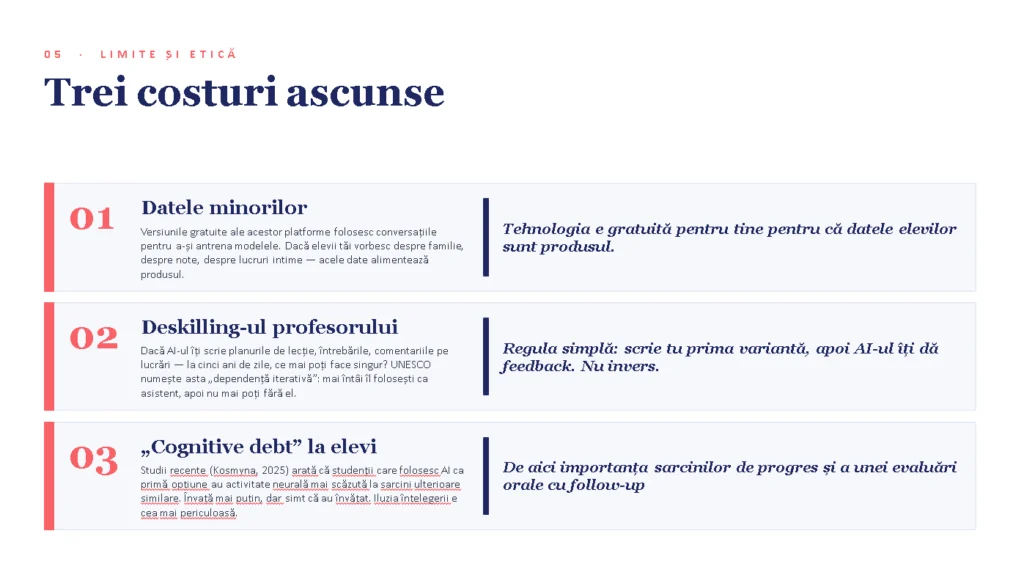

Unul din principalele riscuri care vine la pachet cu folosirea regulată a AI este fenomenul de „cognitive debt”. Pentru a-l exemplifica, Gross face referire la un studiu realizat în 2025. În cadrul acestuia, trei grupuri de elevi au avut de realizat o sarcină: unii folosind AI, unii folosind Google și propria minte, iar unii folosindu-și doar propria minte. Rezultatele au arătat că, deși nu exista o diferență majoră între grupul care a folosit Google și cel care a folosit doar propriile capabilități mintale, cei care au folosit AI au rămas cu mult mai puține informații, nefiind în stare să reproducă ideile din propriul material.

Un alt aspect este și fenomenul de „deskilling” al profesorilor. Riscul apare atunci când aceștia se folosesc excesiv de AI în realizarea planurilor de lecție, comentarii pe lucrări etc. Astfel, profesorii pot ajunge în câțiva ani în situația în care să nu mai fie capabili să își îndeplinească munca fără ajutorul AI – „Dacă AI-ul îți scrie planurile de lecție, întrebările, comentariile pe lucrări — la cinci ani de zile, ce mai poți face singur? UNESCO numește asta „dependență iterativă”: mai întâi îl folosești ca asistent, apoi nu mai poți fără el.”

Problema poate cea mai des discutată în spațiul public o reprezintă prelucrarea datelor, iar ea devine și mai profundă în momentul în care acestea aparțin minorilor. Gross face referire la sintagma cunoscută „dacă ceva e gratuit, atunci noi suntem produsul”:

„Versiunile gratuite ale acestor platforme folosesc conversațiile pentru a-și antrena modelele. Dacă elevii tăi vorbesc despre familie, despre note, despre lucruri intime — acele date alimentează produsul.”

Un fenomen pe care l-au puncat și profesorii prezenți a fost felul în care această tehnologie poate crește discrepanța în capacitatea de învățare între elevi. Întrebați de Minodora Sălcudean dacă au observat până acum cazuri în care elevii să acumuleze informații noi și utile în urma folosirii AI, o profesoară a punctat că „progresul se vede la elevul care oricum era interesat să învețe”.

Acest aspect, grupat și cu fenomenul de „cognitive debt”, poate duce la situația neplăcută în care elevii care se chinuiau deja să țină pasul cu colegii lor să pice în capcana AI și să rămână și mai în urmă pe planul dezvoltării educaționale și cognitive.

Ceasul nu mai poate fi dat înapoi – cum ne adaptăm la această tehnologie în viața de zi cu zi

Indiferent de opiniile proprii privind inteligența artificială, un lucru e cert: nu mai avem cum să dăm înapoi. Această tehnologie este ultraprezentă și nu există vreo metodă prin care poate fi înlăturată definitiv. Așadar, nu avem decât să ne adaptăm la noul peisaj media în care ne aflăm.

Accesibilitatea AI il face un instrument greu de refuzat de elevi – „Și eu dacă aș avea o prăjitură pe masă, chiar și dacă sunt la dietă, o mănânc”, spune una din profesoarele din audiență. Sălcudean menționează și de un studiu în progres al unei doctorande de-a sa în care a fost realizat un chestionar la nivel național privind folosirea AI de către elevi. Acesta arată că cea mai mare majoritate a acestora folosesc această tehnologie.

Astfel, discuția se transformă în „Cum putem integra AI ca să fie un ajutor, nu o piedică?”. O aplicație bună a acestei tehnologii ar fi folosirea ei ca sursă rapidă de informație și incorporarea sa ca instrument de învățare. Această strategie poate funcționa dacă este acompaniată de aprofundarea fizică la clasă a subiectelor în care elevii au fost asistați de AI.

Mai mult, este nevoie de sinceritate și asumare și din partea elevilor, dar și a studenților. O profesoară de Limba și Literatura Română povestește cum a ales să renunțe la a mai da teme, alegând mai degrabă să insiste mai mult la clasă asupra lecțiilor care ar fi trebuit făcute acasă. Aceasta ne spune că relația de sinceritate cu studenții privind folosirea AI a determinat-o să ia această decizie.

Cu toate acestea, mai sunt multe aspecte care vor trebui luate în considerarea până la conturarea unui plan concret. O profesoară atrage atenția că și tinerii ar trebui incluși în aceste discuții pentru a li se oferi șansa de a-și face vocea auzită privind acest subiect.

O altă profesoară atrage atenția și că momentan ne aflăm într-o etapă de tranziție și este prea devreme pentru a identifica imaginea de ansamblu și impactul AI asupra educației și a tinerilor – „e prea devreme ca să tragem concluzii”.